1. Innledning og formål

Denne rapporten beskriver visjonen, brukerbehovene, det tekniske konseptet og utviklingsretningen for det AI-drevne kriseresponssystemet under ESAs Civil Security from Space (CSS)-program. Hovedfokuset er på å utnytte satellittbasert jordobservasjon (EO) som den første og viktigste kilden til situasjonsbevissthet i sivile sikkerhetshendelser, supplert med dronedata, AI og edge-baserte beslutningsstøttesystemer.

Målet med prosjektet er å støtte offentlige sikkerhetsorganer med nøyaktig situasjonsforståelse i sanntid og over et stort område, selv i fjerntliggende eller frakoblede miljøer. Dette dokumentet er en strategisk og teknisk oversikt, og inneholder innsikt fra intervjuer med interessenter, workshoper og innledende systemdesign.

2. Satellitt først: Strategisk prioritering for bredde, kontinuitet og bevissthet

Jordobservasjonsdata (EO-data) utgjør kjernen i systemarkitekturen. Satellittdata gir uovertruffen geografisk dekning, hyppige sykluser og muligheten til å oppdage endringer og mønstre over store områder. I krisesituasjoner gjør dette det mulig å oppdage

- Forsvunne fartøyer til sjøs og telt/tilfluktsrom i ødemarken

- Fuktighetsnivåer i våtmarker, innsjøer og elvebredder for å informere om modellering av bortkomne personers atferd

- Hydrologisk estimering for å støtte både søk og redning og skogbrannberedskap

- Deteksjon av hotspots og kartlegging av konsekvenser etter hendelser

Prosjektet utarbeider aktivt hypoteser og brukstilfeller i samarbeid med operative interessenter, og gir deretter satellittene oppgaver i henhold til disse. Denne prosessen er unik i det sivile domenet og bygger sterke, bruksdrevne valideringsrutiner.

Satellittkommunikasjon (SatCom) utfyller EO ved å sikre kontinuitet i kommunikasjonen i hele systemet. Spesielt i områder med begrenset landbasert dekning gjør SatCom det mulig for edge-enheter og feltteam å opprettholde kontakt og strømme kritiske varsler.

3. Droner som operative supplementer

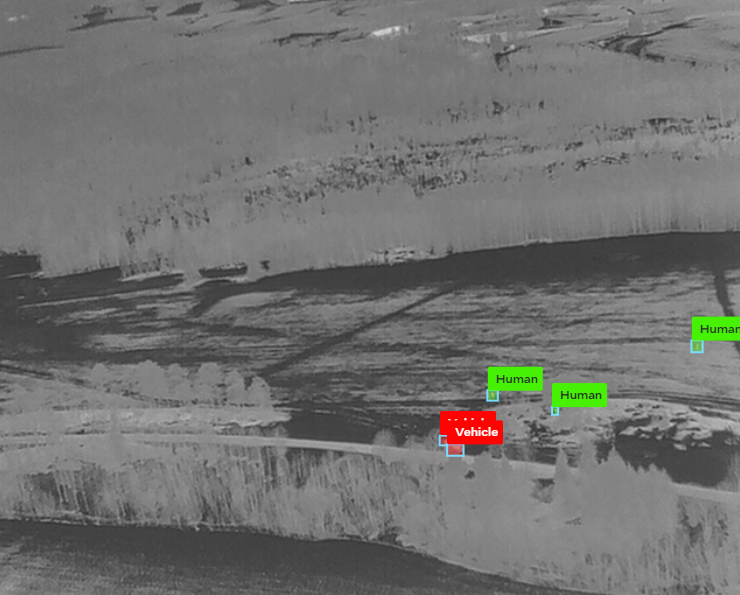

Mens satellitter gir storskala, ovenfra og ned-over-overvåking, tilbyr droner hyperlokale detaljer, fleksibilitet og umiddelbarhet. I dette systemet brukes droner til å

- Verifisere avvik oppdaget i satellittdata (f.eks. varmesignaturer eller mistenkte leirer)

- Leverer høyoppløselige bilder og termisk video som supplement til andre EO-kilder

- Bistå feltmannskaper med sanntidsperspektiver fra luften i komplekst terreng

I områder uten forbindelse kan droner utstyrt med EAIPS (edge AI-prosessering) sende komprimerte varsler via SatCom, noe som sikrer operativ relevans selv uten LTE.

Bruksområder inkluderer: - Visuell og termisk bekreftelse av potensielle leirplasser for bortkomne turgåere i fjelldaler - Klassifisering av oljetyper i fjorder ved hjelp av droner etter satellittdeteksjon - Dynamisk terrengkartlegging for å hjelpe redningsmannskaper i situasjoner etter jordskred.

4. Interessentenes behov og operasjonelle krav

Intervjuer med interessenter har avdekket gjennomgående prioriteringer:

- Informasjon i sanntid: Satellittdata leveres innen 12 til 24 timer; dronedata leveres med mindre enn 10 sekunders ventetid når det er mulig.

- Robust brukervennlighet: integrering i allerede etablerte driftssystemer, oppstart med én knapp, lave opplæringskostnader

- Integrerte visninger: kombinere satellitt-, drone- og bakkeinformasjon i ett kart, i deres allerede eksisterende Common Operating Picture

- Mulighet for frakobling: lokal prosessering med valgfri SatCom fallback

- Sikre og lukkede datamiljøer

Denne innsikten har formet den tekniske arkitekturen og strategien for brukergrensesnittet.

5. Teknisk systemoversikt

Systemet består av tre hovedkomponenter:

- AIDFP (AI-drevet datafusjonsplattform): integrerer EO-, drone- og feltdata til et enhetlig operasjonsbilde, utplassert på et sikkert sted i Nord-Norge

- EAIPS (Edge AI Processing Software): utplassert i felten, behandler video- og sensordata lokalt og genererer varsler i nær sanntid

- AITAF (AI Training and Annotation Framework): muliggjør menneskelig tilbakemelding og korrigering av AI-modeller for å sikre kontinuerlig læring og forbedring

Disse komponentene samhandler via sikre API-er og støtter sanntids dashbord, mobile grensesnitt og systemintegrasjon med nasjonale kommando- og kontrollinfrastrukturer (C2).

EAIPS edge-enhetene drives av robuste, høytytende datamoduler som kan kjøre lette AI-inferensmodeller ute i felten. Hver enhet støtter innebygd prosessering, offline-funksjonalitet og robuste tilkoblingsmuligheter for å opprettholde operativ effektivitet i frakoblede scenarier.

Prosjektet drar nytte av maskinvare- og programvarestøtte fra Intel, som inkluderer servere med høy ytelse for videoanalyse og multimodal inferens, inkludert tidlig testing av transformatorbaserte modeller på Gaudi-plattformer. Dette gjør det mulig å raskt lage prototyper og benchmarking av multimodale AI-agenter i simulerte miljøer og laboratoriemiljøer, noe som sikrer at de er klare til å tas i bruk i den virkelige verden i fremtiden.

Denne konfigurasjonen sikrer at objektdeteksjon, segmentering og anomaliscoring kan skje selv uten en oppstrøms tilkobling.

6. AI og mennesket i loopen: Tillit gjennom samarbeid

AI brukes til objektdeteksjon, termisk segmentering, hotspot-prediksjon og endringsdeteksjon. Bruksområdene omfatter blant annet identifisering av telt, båter, menneskeskikkelser og terrengavvik. Human-in-the-loop (HITL)-verifisering sikrer at:

- Avgjørelser av kritisk betydning blir alltid tatt etter nøye overveielse.

- Eksperter kan gå gjennom og kommentere flagget innhold

- Skjevheter i data og overtilpasning identifiseres tidlig

For å gjøre HITL-funksjonaliteten mer brukervennlig vil den bli distribuert gjennom en brukervennlig nettportal og mobilapplikasjon. Dette grensesnittet vil gjøre det mulig for feltpersonell, analytikere og koordinatorer å enkelt validere AI-genererte resultater, gi tilbakemeldinger og merke hendelser eller avvik ved hjelp av nettbrett eller smarttelefoner. Målet er å sikre at løsningen er fullt operativ i felten, selv under stress og tidspress.

Det mobile grensesnittet gjør det også mulig å inkludere dyktige frivillige, analytikere eller pensjonerte fagfolk som ellers ikke ville vært til stede i felten. Disse kan validere flaggede funn på avstand, noe som øker antallet tilgjengelige menneskelige ressurser ved kritiske hendelser betraktelig.

Bekreftede avvik fra både satellitt- og dronedata - når de er verifisert av et menneske - vil bli geomarkert og vist direkte på Common Operating Picture (COP), komplett med bildekontekst og konfidensnivå. Anta for eksempel at en droneoperatør identifiserer en jakke som samsvarer med beskrivelsen av den savnede personen. I så fall kan denne observasjonen flagges via HITL og automatisk integreres i COP som et funn med høy prioritet, sammen med kartplassering og visuelt vedlegg.

Denne samarbeidsstrategien for kunstig intelligens sikrer både robusthet og driftssikkerhet.

7. Innsikt fra engasjement fra interessenter

Prosjektet har engasjert et bredt og representativt utvalg av interessenter fra hele det sivile sikkerhetsområdet, blant annet

- Brann- og redningstjenester

- Frivillige organisasjoner for søk og redning

- Koordineringsenheter for politi og offentlig orden

- Nasjonale og regionale redningskoordineringssentraler

- Leverandører av satellittdata og jordobservasjon

På tvers av disse gruppene er det sterk støtte for en satellittbasert tilnærming til situasjonsbevissthet, med droner som sørger for verifisering på taktisk nivå, og AI-systemer som støtter både automatisering og menneskelig beslutningstaking. Alle parter understreket viktigheten av intuitive verktøy, rask datatilgang, arbeidsflyter for menneskelig validering og sømløs integrering i eksisterende kommando- og kontrollsystemer.

8. Neste trinn: Hypoteser, datainnsamling og validering

Prosjektet vil sette i gang en strukturert idémyldringsprosess blant de deltakende organisasjonene for å identifisere hypoteser med stor gjennomslagskraft for satellitt- og dronebasert situasjonsforståelse. Disse hypotesene vil være forankret i reelle operative behov, for eksempel å identifisere objekter, endringer eller forhold i komplekst terreng og avsidesliggende regioner. Når hypotesene er definert, vil prosjektet systematisk samle inn relevante satellittbilder og sensordata for å verifisere eller avkrefte hver hypotese.

Eksempler på potensielle hypoteser er blant annet

- Oppdagelse av små telt i fjellterreng

- Segmentering og rangering av våtmarker etter fuktighetsnivå for å støtte modellering av atferden til personer som har gått seg bort

- Identifisering av drivende fartøy ved hjelp av tidsseriedata fra satellitt og AI-mønstergjenkjenning

Planlagte droneoppdrag vil validere AI-funn fra satellittdata ved å samle inn høyoppløselige bilder, termisk bekreftelse og menneskelig kommentert bakkesannhet. Hver hypotese vil bli behandlet som et eget scenario, med nøye loggføring av inndata, AI-resultater, valideringstrinn og bekreftelsesmålinger.

Validerte observasjoner - enten de kommer fra drone eller satellitt - vil bli geomarkert og integrert i Common Operating Picture (COP) med tilhørende grafikk og metadata, noe som muliggjør evidensbasert beslutningstaking og strategisk koordinering.

Denne syklusen med idéutvikling, datainnsamling, analyse og validering sikrer både vitenskapelig stringens og nytteverdi i den virkelige verden.

9. Anbefalinger og fremtidig retning

- Prioriter satellittbasert deteksjon, med dronestøttet bekreftelse

- Fortsett å utvikle multimodal AI (EO + drone + menneske)

- Sikre HITL-valideringsrutiner i alle større brukstilfeller

- Opprettholder edge-first, offline-kompatibel design, med valgfri SatCom-støtte

- Utvide systemet til et modulbasert verktøysett for samfunnssikkerhet i hele Europa

- Integrer lette digitale tvillinger av kritisk infrastruktur for sanntidssynkronisering av tilstanden

Fremtidig bruk av multimodale agenter på Edge

Etter hvert som AI-modellene utvikler seg, vil det bli mulig å ta i bruk fullt ut multimodale agenter på edge-enheter. Disse agentene vil være i stand til å kombinere visuelle (optiske, termiske), SAR-, meteorologiske og geospatiale tekstdata for å gjøre selvstendige vurderinger i felten. En agent kan for eksempel motta satellittavledede flomvarsler, korrelere dem med dronebasert kartlegging av vanndybde, spørre lokale digitale tvillingmodeller om sårbarheter i infrastrukturen og generere forslag til evakueringssoner i sanntid.

Bruk av disse agentene krever maskinvare som støtter: - Effektive transformatorarkitekturer eller GNN-er (grafnevrale nettverk) - LLM-finjustering eller inferens på enheten - Lokal sensorfusjon med asynkrone inndata - Digital tvillingtilstandshåndtering og -synkronisering - Modellcontainerisering via Docker/K3s for pålitelighet.

Denne visjonen vil gradvis bli integrert i EAIPS' veikart, noe som vil sikre kompatibilitet med nye prosessorplattformer fra Intel og det bredere Edge AI-økosystemet.

10. Vedlegg

Ytterligere dokumentasjon er tilgjengelig på forespørsel.

Andre nyhetssaker

Vi holder deg oppdatert!